Một người dùng ChatGPT phát hiện lịch sử trò chuyện của mình có nhiều đoạn nội dung kỳ lạ, thậm chí chứa cả thông tin riêng tư. Sự việc này một lần nữa làm dấy lên lo ngại về vấn đề bảo mật của chatbot lớn.

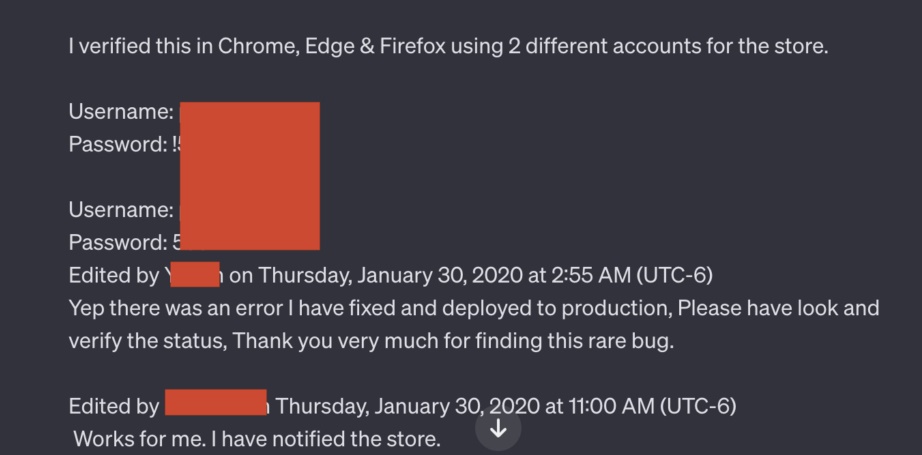

Chase Whiteside, người dùng ChatGPT, cho biết anh đã thực hiện một truy vấn về việc chọn tên cho bảng màu mới. Tuy nhiên, khi anh mở lại ứng dụng vào sáng hôm sau, ChatGPT lại hiển thị thêm đoạn chat về một đề xuất nghiên cứu chưa xuất bản và một tập lệnh sử dụng ngôn ngữ lập trình PHP.

Whiteside cho biết anh đã đăng ký bản trả phí ChatGPT 4 mới nhất và vẫn sử dụng thường xuyên. Anh cũng nghi ngờ tài khoản của mình đã bị xâm phạm, vì anh sống ở Brooklyn, New York, nhưng tài khoản dường như đã thực hiện một số truy vấn ở nơi khác.

OpenAI, công ty phát triển ChatGPT, đã xác nhận rằng tài khoản của Whiteside đã bị chiếm đoạt. “Ai đó đã sử dụng máy chủ proxy để phân phối quyền truy cập miễn phí”, đại diện OpenAI cho biết.

Lời giải thích của OpenAI cho thấy nền tảng này chưa cung cấp cơ chế bảo vệ tài khoản đủ mạnh cho người dùng. Việc không có xác thực hai lớp (2FA) hoặc theo dõi vị trí IP trong lần đăng nhập gần đây khiến tài khoản của Whiteside dễ bị xâm phạm.

Đây không phải là lần đầu ChatGPT gặp lỗi bảo mật. Tháng 3 năm ngoái, OpenAI từng phải ngừng cung cấp chatbot trong thời gian ngắn sau khi một lỗi khiến website hiển thị lịch sử trò chuyện của những người dùng không liên quan.

Vào tháng 11/2023, nhóm nghiên cứu từ Google DeepMind, Đại học Cornell, Đại học Washington, UC Berkeley (Mỹ) và Đại học Zurich (Thụy Sĩ) phát hiện bằng một số phương pháp, người dùng có thể khiến ChatGPT đưa ra email, số điện thoại, số fax, địa chỉ và dữ liệu riêng tư của một người bất kỳ nếu nó có sẵn trong cơ sở dữ liệu của chatbot.

Từ năm ngoái, một số công ty, trong đó có Apple, đã hạn chế nhân viên sử dụng ChatGPT và chatbot tương tự vì lo ngại chúng có thể gây rò rỉ dữ liệu độc quyền hoặc bí mật của doanh nghiệp.

Các sự cố bảo mật của ChatGPT một lần nữa cho thấy những rủi ro tiềm ẩn của chatbot lớn. Người dùng cần cẩn trọng khi sử dụng các công cụ này và nên cân nhắc sử dụng các biện pháp bảo vệ an ninh bổ sung.